La IA ha cruzado una línea invisible.

Ya no se limita a respaldar las decisiones humanas. Cada vez más, las inicia, integradas en los flujos de trabajo, operando a la velocidad de las máquinas e interactuando directamente con sistemas críticos. La IA autónoma se está convirtiendo en un participante activo dentro de la empresa, y ese cambio está obligando a los responsables de seguridad a replantearse cómo se establece, se aplica y se escala la confianza.

Para Jordan Rackie, Keyfactor , este momento representa un punto de inflexión fundamental. Las organizaciones han dedicado décadas a modernizar la identidad de las personas y las máquinas, pasando de las contraseñas a la autenticación multifactorial y a los certificados para dispositivos, servidores y cargas de trabajo. Cada paso requería nuevos supuestos sobre la confianza. Ahora, la IA está llevando esos supuestos al límite.

«No permitirías que un empleado trabajara sin una identidad, permisos definidos o responsabilidad. Los agentes de IA merecen, y requieren, el mismo rigor», explica Rackie.

Los sistemas de IA agenciales no se limitan a ayudar a los seres humanos. Actúan por su cuenta: ponen en marcha infraestructuras, modifican códigos, acceden a datos confidenciales y activan procesos posteriores en distintos entornos. Sin embargo, muchas organizaciones siguen protegiendo estos sistemas con los mismos atajos que antes se aplicaban a los scripts y la automatización básica. La discrepancia entre la capacidad y el control es cada vez más difícil de ignorar.

Esa tensión —entre la autonomía acelerada y la frágil confianza— es la base de la nueva Digital Trust Digest: Edición sobre identidad en IA.

Identidad de la IA: por qué los sistemas autónomos lo cambian todo

En esta nueva edición de la serie completa de revistas Keyfactor, analizamos la identidad de la IA, la IA agencial y lo que significan para la confianza digital a gran escala.

Los artículos de la revista se basan en las opiniones de 450 profesionales de la seguridad de Norteamérica y Europa. Sus respuestas revelan deficiencias sistemáticas en la gobernanza, puntos ciegos en materia de identidad y una creciente preocupación por los sistemas autónomos que funcionan sin controles estrictos.

Aunque existe una gran concienciación sobre los riesgos que plantea la IA, la confianza en la capacidad para identificar, controlar o desactivar un agente de IA malicioso sigue siendo mucho menor.

A lo largo de todo el número, hay un tema que se repite: la autonomía está creciendo más rápido que la confianza.

La identidad ocupa un lugar central en ese desafío. Cuando los sistemas de IA actúan de forma independiente, la identidad define quién o qué es el agente, la autorización establece los límites y la evaluación continua garantiza que esos límites sigan teniendo sentido a medida que evolucionan el riesgo y el contexto. Sin esa base, la responsabilidad desaparece y el riesgo se expande silenciosamente.

Operación de PKI a escala de IA

Ted Shorter, director técnico y cofundador Keyfactor, aporta una perspectiva complementaria en su contribución a la edición, basando el debate sobre la identidad de la IA en la realidad operativa.

«El reto que tenemos por delante no es adoptar certificados. Es operar PKI a escala de IA», afirma Shorter.

La IA autónoma introduce características que ponen a prueba las implementaciones tradicionales de PKI. Los agentes son dinámicos, efímeros, masivamente paralelos y capaces de actuar de forma independiente en distintos entornos. Los ciclos de vida de los certificados se multiplican. Las relaciones de confianza se amplían. Los modos de fallo se aceleran. Los sistemas diseñados para infraestructuras estáticas o cambios al ritmo humano tienen dificultades para seguir el ritmo cuando la IA opera a la velocidad de las máquinas.

Aquí es donde la confianza digital se convierte tanto en un problema de ingeniería como de gobernanza. La identidad debe ser criptográficamente sólida, totalmente automatizada y resistente por diseño, o no resistirá el peso de los sistemas autónomos.

La edición AI Identity Edition aúna estas realidades técnicas con perspectivas más amplias de gobernanza y liderazgo.

Además de las opiniones del Keyfactor , el número incluye contribuciones externas de IBM, AWS y Delinea, junto con comentarios expertos de Kay Firth-Butterfield, una de las voces más destacadas a nivel mundial en materia de gobernanza de la IA y IA responsable. Su perspectiva refuerza un punto fundamental: la confianza en la IA no se limita a los controles de seguridad. Se trata de la intención, la responsabilidad y el liderazgo.

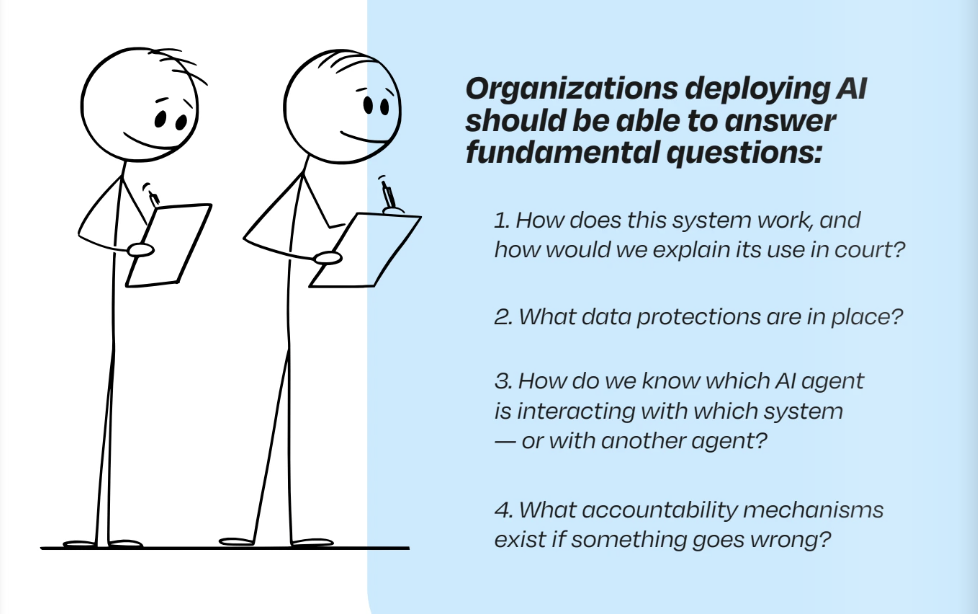

El mensaje principal de la revista es coherente: la autonomía sin intención es un riesgo. La pregunta más difícil en una empresa impulsada por la IA no es si un agente puede actuar, sino si debe hacerlo, en qué condiciones y si esa decisión puede explicarse, auditarse y revertirse cuando sea necesario.

Por eso, la AI Identity Edition es importante para los responsables de seguridad. Los colaboradores de la revista convierten la investigación, la experiencia y los conocimientos de los expertos en orientaciones prácticas, lo que ayuda a las organizaciones a comprender en qué aspectos sus modelos de confianza son válidos, en cuáles no lo son y qué es lo que hay que cambiar a medida que la IA adquiere una autoridad real.

¿Listo para ver dónde te encuentras?

Si la IA ya desempeña un papel en su organización, o lo hará pronto, esta edición está escrita para usted. Sumérjase en la revista, repleta de marcos prácticos y orientación normativa para pasar de la concienciación a la acción.

👉 Explore el Digital Trust Digest: Edición sobre identidad en IA