Es vergeht kaum ein Tag, an dem man nicht von generativer KI hört. Aber was bedeutet das wirklich für Ihr Unternehmen, wenn wir über den Hype hinausblicken?

Wir haben uns kürzlich mit Ryan Sanders, Sr.Director of Product and Customer Marketing bei Keyfactor, Ellen Boehm, SVP of IoT Strategies and Operations bei Keyfactor, und Jason Slack, Director of Product Engineering bei Truepic, um diese Frage eingehend zu beantworten. Die Diskussion drehte sich um die Chancen, Gefahren und geschäftlichen Auswirkungen von generativer KI, die Bedeutung von Identität und Authentizität in einer Null-Vertrauens-Weltund wie man mit PKI Vertrauen aufbauen kann.

Einführung in das Zeitalter der generativen KI

KI ist nichts Neues. Die jüngsten Entwicklungen, vor allem GPT-3 und ChatGPT, haben KI jedoch sehr praktisch und für den Durchschnittsbürger zugänglich gemacht.

Laut Gartner haben seit der Veröffentlichung von ChatGPT im November 2022 45 % der Unternehmen ihre Investitionen in KI erhöht. Gartner prognostiziert außerdem, dass die meisten Technologieprodukte und -dienstleistungen innerhalb des nächsten Jahres eine Art von generativen KI-Funktionen enthalten werden.

Wovon reden wir also genau? Generative KI kann Texte, Bilder und Videos produzieren. Sie kann auch Code überprüfen und refaktorisieren oder sogar als Co-Pilot für IT- und Sicherheitsteams dienen. Und diese Beispiele kratzen nur an der Oberfläche dessen, was möglich ist.

Letztendlich macht generative KI die Prozessautomatisierung viel zugänglicher, was sowohl Chancen als auch Risiken mit sich bringt - denn Sie können darauf wetten, dass, während Unternehmen ihre Investitionen in KI erhöhen, Angriffsgruppen und Hacker genau dieselben Strategien anwenden.

Die Auswirkungen der generativen KI: Chancen und Risiken

Wie jede neue Technologie birgt auch die generative KI Chancen und Risiken, und es ist wichtig, beide Seiten der Gleichung zu verstehen. Was die Chancen betrifft, so sehen wir vier wichtige Anwendungsfälle:

- Code-Generierung und -Tests: Generative KI ermöglicht es Entwicklern, Code viel schneller zu erstellen, den die Teams dann iterieren können. Dies ermöglicht effizientere Leistungs- und QA-Tests und einen schnelleren Weg zur Bereitstellung eines minimalen lebensfähigen Produkts.

- Automatisierung der Sicherheit: Generative KI kann auch den Prozess des Testens gegen Angriffe automatisieren, um die Sicherheit für neue Technologien zu verbessern.

- Generierung von Inhalten: Ob es sich um neue Marketingbotschaften, Bilder und Videos, Skripte oder andere Dinge handelt, generative KI hat bei der Erstellung von Inhalten für Furore gesorgt und hilft den Menschen, eine Botschaft schnell und effektiv an ein breites Publikum zu übermitteln.

- KI-Assistenten und Innovation: Schließlich besteht das Potenzial, dass generative KI eine Art Assistentenfunktion übernimmt und Teams bei der Innovation unterstützt, indem sie neue Geschäftsmodelle oder neue Konzepte zur Unterstützung der Arbeitserledigung entwickelt.

Zu den größten Risiken der generativen KI, die wir sehen, gehören unter anderem:

- KI-generierte Malware: Die Fähigkeit der generativen KI, Malware in schnellem Tempo zu erstellen, kann nicht nur zu intelligenteren Angriffen auf software und Geräte führen, sondern auch zu häufigeren Angriffen.

- Automatisierung von Angriffen: KI kann Angriffe wie DDoS so weit automatisieren, dass Menschen gar nicht mehr beteiligt sein müssen. Anstatt ein Netzwerk kompromittierter IoT Geräte zu nutzen, um einen Server anzugreifen, können Angreifer ein Netzwerk KI-gesteuerter Bots erstellen, die den Datenverkehr überfluten und Server zu geringen Kosten lahmlegen.

- Fälschungen: Deep Fakes, also Videos und Bilder, die digital verändert wurden, um Themen falsch darzustellen, können Fehlinformationen verbreiten. Wir haben in den Nachrichten bereits Beispiele dafür gesehen, wie Nationalstaaten mit KI-generierten politischen Anzeigen versuchen, die Entscheidungsfindung von Menschen in aller Welt zu beeinflussen.

- Datenschutz- und Urheberrechtsprobleme: Generative KI kann es leicht machen, gefälschte Inhalte und Informationen zu erstellen, und wenn diese als echt ausgegeben werden, kann dies ernsthafte urheberrechtliche Bedenken hervorrufen oder sogar den Datenschutz verletzen, wenn dies Auswirkungen auf die laufende Kommunikation hat.

Wie man generative KI sicher und verantwortungsbewusst einsetzt

Ein verantwortungsvoller Umgang mit generativer KI setzt Authentizität und Transparenz voraus. Diese beiden Grundsätze stehen im Mittelpunkt von Truepic, einem Kunden von Keyfactor, und einem Pionier auf dem Gebiet der Bildauthentizität, der eine branchenführende Controlled-Capture-Technologie anbietet, um die Integrität digitaler Fotos und Videos ab dem Moment ihrer Aufnahme zu gewährleisten.

Jason erklärt: "Einer der wichtigsten Grundsätze bei der Gründung von Truepic war Authentizität - eine Kamera zu verwenden, der man vertraut, und sicherzustellen, dass das, was man sieht, nicht bearbeitet wurde. Jetzt betrachten wir Transparenz als einen wichtigen Teil davon und erkennen an, dass es in Ordnung ist, Bearbeitungen zu haben, solange man transparent macht, woher etwas kommt."

Diese Konzepte erstrecken sich auch auf die generative KI, da Unternehmen, die KI zur Generierung von Sprache oder Bildern einsetzen, transparent machen sollten, welche Werkzeuge und Eingabeaufforderungen zur Erstellung des Ergebnisses verwendet werden. Letztendlich sieht Jason dies als eine Art "Zutatenliste" für Bilder und Videos.

Diese Art des Denkens hat Organisationen wie Truepic dazu veranlasst, die Coalition for Content Provenance and Authenticity (C2PA) zu gründen, die einen offenen technischen Standard für Herausgeber, Ersteller und Verbraucher bereitstellt, um die Herkunft verschiedener Medientypen nachzuvollziehen. Im Kern geht es bei dieser Art von Sicherheit um die Verwendung von PKI-basierten digitalen Signaturen zum Nachweis der Authentizität.

Die Bedeutung von Vertrauen und Transparenz in einer KI-Welt

Woher wissen wir in einer Welt der KI-generierten Inhalte, was echt oder synthetisch, original oder bearbeitet ist? Betrachten Sie das folgende Video von Truepic und Revel AIdas die Macht eines tiefgründigen Fake-Videos zeigt.

Bei den Inhalten, die wir online sehen, galt früher die Regel "vertraue und überprüfe", aber Fortschritte wie die generative KI haben das geändert. Jetzt müssen wir den Ansatz "niemals vertrauen und immer überprüfen" verfolgen, und in dieser Welt ist es wichtig zu verstehen, woher die Inhalte kommen.

Wie können wir also Vertrauen und Transparenz gewährleisten?

Die Einführung des C2PA-Standards im gesamten Medienbereich kann dazu beitragen, dass Bilder und Videos einfach signiert werden können und Informationen wie Herkunft, Bearbeitung und Ersteller kryptografisch mit den Medien verknüpft werden. Dies schafft Transparenz, so dass die Menschen darauf vertrauen können, dass das, was sie sehen, echt ist, oder wissen, woher die veränderten Dateien stammen.

Diese Bemühungen müssen auch auf andere Bereiche ausgedehnt werden. Nehmen wir das Beispiel von software code. Generative KI kann zur schnellen Erstellung von Code und zum Testen eingesetzt werden, wodurch die Entwicklungsteams wesentlich flexibler werden können. Doch mit der gesteigerten Effizienz geht die Notwendigkeit einher, zu beweisen, dass derjenige, der den Code schreibt, auch wirklich der vorgesehene Entwickler ist und dass nicht einmal ein kleines Stück gefälschten Codes oder Malware in ein größeres Paket eingeschleust wird. Folglich wird die Fähigkeit, neue Codes ordnungsgemäß digital zu signieren, immer wichtiger.

Dies bringt uns zur Rolle von PKI und Code-Signierung, die die Grundlage für die Überprüfung der Authentizität und Herkunft von Inhalten bilden. Glücklicherweise ist die PKI sehr gut etabliert und unterstützt digitales Vertrauen Sie unterstützt seit Jahrzehnten das digitale Vertrauen in Unternehmen, indem sie die Authentizität nachweist, die Herkunft neuer Dinge überprüft und es uns ermöglicht, Daten über verschlüsselte Kanäle zu senden, um ein Abfangen durch böswillige Parteien zu verhindern.

Fallstudie: Truepic und Keyfactor

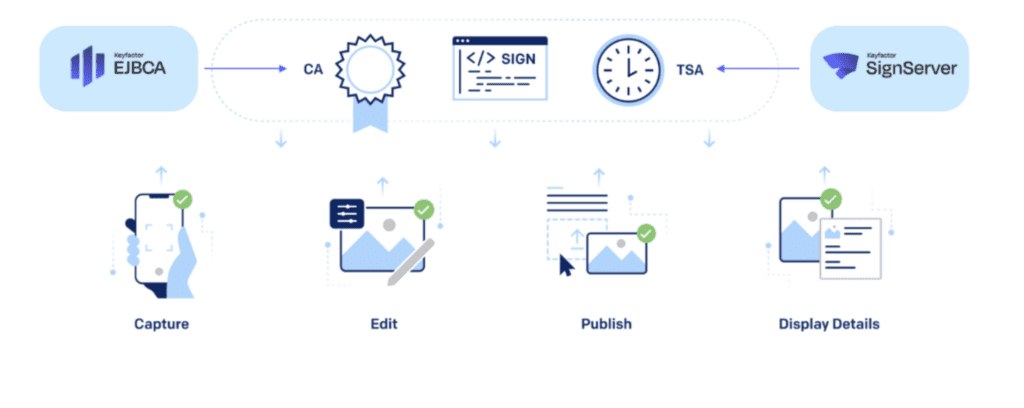

Als der C2PA-Standard aufkam, beschloss Truepic, ihn in seine Produkte zu integrieren, damit die Benutzer den C2PA-Standard der Informationen in ihren Bilddateien kryptografisch versiegeln können. Auf der Suche nach einem Partner, der diese Kryptographie unterstützt, wurde Keyfactor zum Klassenbesten für die PKI-Infrastruktur dank EJBCA und eine Partnerschaft mit SignServer.

Truepic's Controlled Capture Technologie und Lens Produkt verwenden EJBCA und SignServer um Herkunftsdaten zu erfassen und Inhalte kryptografisch zu signieren, um die Authentizität zu überprüfen. Diese Verwendung von PKI macht den Prozess skalierbarer und flexibler für die Nutzer, als wenn man sich auf ein Blockchain-Ledger verlässt.

Und so funktioniert es:

KI ist da, und Vertrauen und Transparenz müssen mit ihr einhergehen

Ob wir nun bereit sind oder nicht, das Zeitalter der generativen KI ist angebrochen, und wir können uns nur dann erfolgreich weiterentwickeln, wenn wir auf Vertrauen und Transparenz setzen.

Zum Glück, PKI-Prinzipien wie digitale Signaturen die notwendigen Bausteine, um Vertrauen und Transparenz zu fördern. Die nächsten Schritte bestehen darin, diese Grundsätze in neue Bereiche - wie Bilder und Videos - einzubetten, um sicherzustellen, dass sie richtig verwendet werden, und die Öffentlichkeit darüber aufzuklären, worauf sie achten muss, um die Authentizität zu überprüfen. Und wenn wir das tun, können wir beginnen, alle Vorteile (und es gibt viele!) zu nutzen, die generative KI zu bieten hat.

Schauen Sie sich das vollständige Webinar an, um einen tieferen Einblick in die Anforderungen zu erhalten und zu erfahren, wie Truepic mit Keyfactor zusammenarbeitet, um eine führende Rolle zu übernehmen.