Es imposible pasar un día sin oír hablar de la IA generativa. Pero si miramos más allá del rumor, ¿qué significa realmente para su negocio?

Recientemente nos reunimos con Ryan Sanders, Director Senior de Marketing de Producto y Clientes en Keyfactor, Ellen Boehm, Vicepresidenta Senior de Estrategias y Operaciones de IoT en Keyfactor, y Jason Slack, Director de Ingeniería de Producto en Truepic, para responder a esta pregunta en profundidad. La discusión se centró en las oportunidades, amenazas e implicaciones comerciales de la IA generativa, la importancia de la identidad y la autenticidad en un mundo de confianza cero, y cómo establecer la confianza con PKI.

Presentando la era de la IA generativa

La IA no es nada nuevo. Sin embargo, los desarrollos recientes, especialmente GPT-3 y ChatGPT, han hecho que la IA sea muy práctica y accesible para la persona promedio.

Según Gartner, desde el lanzamiento de ChatGPT en noviembre de 2022, el 45% de las organizaciones ha aumentado su inversión en IA. Gartner también predice que la mayoría de los productos y servicios tecnológicos incorporarán algún tipo de capacidades de IA generativa en el próximo año.

¿De qué estamos hablando exactamente? La IA generativa puede producir texto, imágenes y vídeos. También puede revisar y refactorizar código, o incluso servir como copiloto para equipos de TI y seguridad. Y estos ejemplos solo arañan la superficie de lo que es posible.

En última instancia, la IA generativa hace que la automatización de procesos sea mucho más accesible, lo que genera tanto oportunidades como riesgos, porque es seguro que, mientras las organizaciones aumentan su inversión en IA, los grupos de ataque y los hackers están adoptando exactamente las mismas estrategias.

El impacto de la IA generativa: oportunidades frente a riesgos

Como cualquier nueva tecnología, la IA generativa conlleva oportunidades y riesgos, y es importante comprender ambas caras de la ecuación. En cuanto a las oportunidades, identificamos cuatro casos de uso clave:

- Generación y pruebas de código: La IA generativa permite a los desarrolladores crear código mucho más rápidamente, sobre el cual los equipos pueden iterar. Esto permite pruebas de rendimiento y control de calidad más eficientes, y un camino más rápido para entregar un producto mínimo viable.

- Automatización de la seguridad: La IA generativa también puede automatizar el proceso de pruebas contra ataques para mejorar la seguridad de las nuevas tecnologías.

- Generación de contenido: Ya sean nuevos mensajes de marketing, imágenes y vídeos, guiones o cualquier otra cosa, la IA generativa ha causado un gran impacto en la generación de contenido, ayudando a las personas a transmitir un mensaje a una amplia audiencia de forma rápida y eficaz.

- Asistentes de IA e innovación: Finalmente, existe el potencial de que la IA generativa desempeñe un papel de asistente, ayudando a los equipos a innovar al proponer diferentes modelos de negocio o nuevos conceptos para apoyar la forma en que se realiza el trabajo.

Mientras tanto, algunos de los mayores riesgos de la IA generativa que observamos incluyen:

- Malware generado por IA: La capacidad de la IA generativa para crear malware a un ritmo rápido no solo puede conducir a ataques más inteligentes contra Software y dispositivos, sino también a ataques más frecuentes.

- Automatización de ataques: La IA puede automatizar ataques, como los DDoS, hasta el punto en que los humanos ni siquiera necesitan participar. Por ejemplo, en lugar de utilizar una red de dispositivos IoT comprometidos para atacar un servidor, los atacantes pueden crear una red de bots impulsados por IA para inundar el tráfico y derribar servidores a bajo coste.

- Deepfakes: Los deepfakes, o vídeos e imágenes que han sido alterados digitalmente para tergiversar sujetos, pueden propagar desinformación. Ya hemos visto ejemplos de esto en las noticias, con estados-nación produciendo anuncios políticos generados por IA que intentan influir en cómo las personas de todo el mundo toman decisiones.

- Preocupaciones sobre la privacidad de datos y los derechos de autor: La IA generativa puede facilitar la creación de contenido e información falsos, y cuando esto se hace pasar por genuino, puede generar serias preocupaciones sobre los derechos de autor o incluso infringir la privacidad de los datos en casos en que afecte a las comunicaciones en curso.

Cómo utilizar la IA generativa de forma segura y responsable

Ser responsable con la IA generativa se reduce a la autenticidad y la transparencia. Estos dos principios son la base de Truepic, un cliente de Keyfactor y pionero en la autenticidad de imágenes que ofrece una tecnología de captura controlada líder en la industria para garantizar la integridad de las fotos y vídeos digitales desde el instante en que son capturados.

Jason explica: «Uno de los principios más importantes en la fundación de Truepic fue la autenticidad: usar una cámara en la que confías y asegurar que lo que ves no ha sido editado. Ahora consideramos la transparencia como una parte importante de ello, reconociendo que está bien tener ediciones siempre y cuando seas transparente sobre el origen de algo».

Estos conceptos se extienden a la IA generativa, ya que las empresas que utilizan IA para generar lenguaje o imágenes deben ser transparentes sobre las herramientas y las indicaciones utilizadas para crear el resultado. En última instancia, Jason considera que esto se convertirá en algo parecido a una «etiqueta de ingredientes» para imágenes y vídeos.

Este tipo de pensamiento ha llevado a organizaciones como Truepic a establecer la Coalición para la Procedencia y Autenticidad del Contenido (C2PA), que proporciona un estándar técnico abierto para que editores, creadores y consumidores rastreen el origen de diferentes tipos de medios. En su esencia, este tipo de seguridad se centra en el uso de firmas digitales basadas en PKI para probar la autenticidad.

La importancia de la confianza y la transparencia en un mundo de IA

En un mundo de contenido generado por IA, ¿cómo sabemos qué es real o sintético, original o editado? Considere el siguiente vídeo de Truepic y Revel AI, que muestra el poder de un vídeo deepfake.

Con el contenido que vemos en línea, la regla solía ser «confiar y verificar», pero avances como la IA generativa han cambiado eso. Ahora, debemos adoptar un enfoque de «nunca confiar y siempre verificar», y en este mundo, es importante comprender de dónde proviene el contenido.

¿Cómo garantizamos entonces la confianza y la transparencia?

La adopción del estándar C2PA en todo el ecosistema de medios puede ayudar al facilitar la firma de imágenes y vídeos y vincular criptográficamente información como su origen, cómo han sido editados y quién los creó al propio medio. Esto proporciona transparencia para que las personas puedan confiar en que lo que ven es real o saber de dónde provienen los archivos alterados.

Estos esfuerzos también deben extenderse a otros ámbitos. Considere el caso del código de Software. La IA generativa puede utilizarse para crear y probar código rápidamente, permitiendo que los equipos de desarrollo sean mucho más ágiles. Pero con esa mayor eficiencia surge la necesidad de demostrar que quien escribe el código es realmente el desarrollador previsto y que ni siquiera una pequeña pieza de código falsificado o malware se incorpore a un paquete más grande. Como resultado, la capacidad de realizar firmas digitales adecuadas en el nuevo código se vuelve aún más importante.

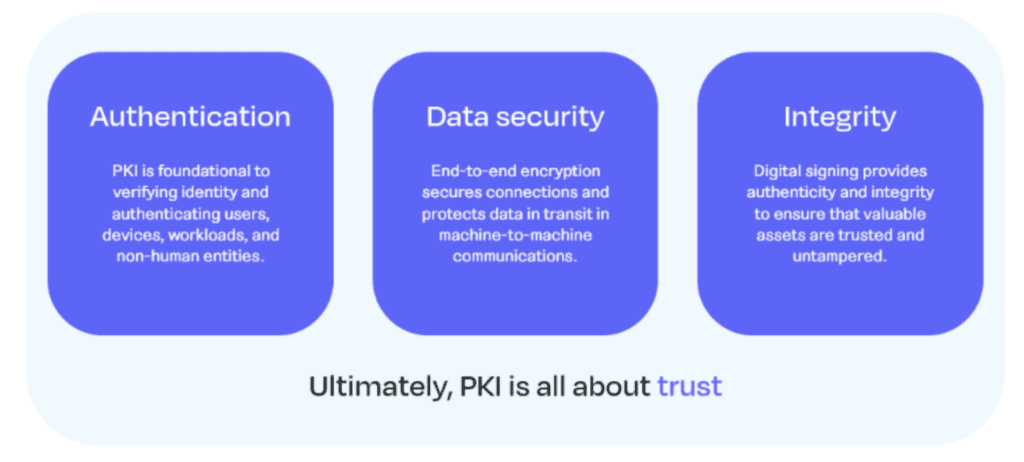

Esto nos lleva al papel de la PKI y la firma de código, que proporcionan la base para verificar la autenticidad y el origen del contenido. Afortunadamente, la PKI está muy bien establecida, apoyando la confianza digital en la empresa durante décadas al probar la autenticidad, validar los orígenes de nuevas entidades y permitirnos enviar datos a través de canales cifrados para evitar la interceptación por parte de terceros malintencionados.

Estudio de caso: Truepic y Keyfactor

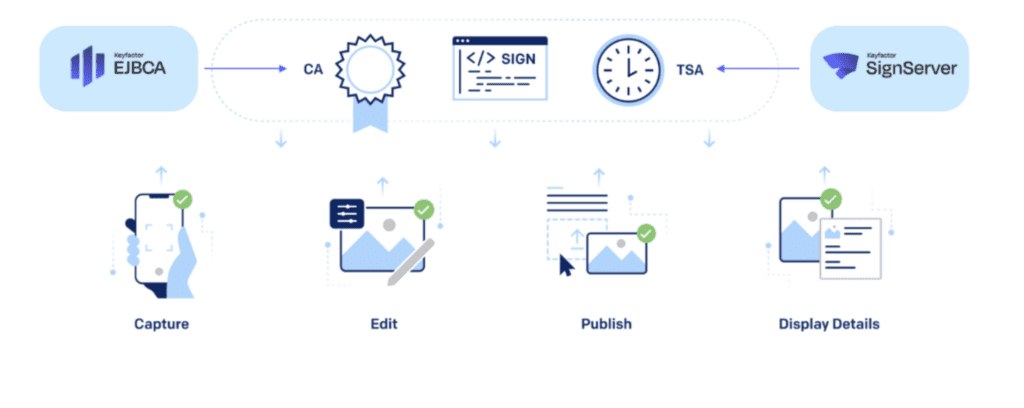

Cuando surgió por primera vez el estándar C2PA, Truepic decidió incorporarlo en sus productos para que los usuarios pudieran sellar criptográficamente la información del estándar C2PA en sus archivos visuales. En la búsqueda de un socio para respaldar esa criptografía, Keyfactor se destacó como el mejor en su clase para la infraestructura PKI gracias a EJBCA y a una asociación con Signserver.

La tecnología Controlled Capture y el producto Lens de Truepic utilizan EJBCA y Signserver para adquirir datos de procedencia y firmar criptográficamente contenido con el fin de verificar su autenticidad. Este uso de PKI hace que el proceso sea más escalable y flexible para los usuarios, en contraste con la dependencia de un libro mayor de blockchain.

Así es como funciona:

La IA ya está aquí, y la confianza y la transparencia deben acompañarla

Estemos o no preparados, la era de la IA generativa ya está aquí, y la única forma de avanzar con éxito es centrarse en la confianza y la transparencia.

Afortunadamente, los principios de PKI, como las firmas digitales, proporcionan los componentes básicos necesarios para fomentar la confianza y la transparencia. Los siguientes pasos son integrar estos principios en nuevas áreas —como imágenes y videos— para asegurar que se utilicen correctamente, y educar al público sobre qué buscar para verificar la autenticidad. Y cuando lo hagamos, podremos empezar a aprovechar todos los beneficios (¡y son muchos!) que la IA generativa tiene para ofrecer.

Vea el webinar completo para una mirada más profunda a lo que se necesita y cómo Truepic está trabajando con Keyfactor para liderar el cambio.