Con la competición de Criptografía Postcuántica (PQC) del NIST entrando en su última fase y la noticia de que IBM construirá una computadora cuántica de 1000 cúbits para 2023, la discusión sobre cómo implementar algoritmos resistentes a la computación cuántica ha cobrado protagonismo.

Durante la Cumbre Virtual de Confianza Crítica de Keyfactor de 2020, Russ Housley, fundador y propietario de Virgil Security, y Massimiliano Pala, arquitecto principal de Servicios de Seguridad e I+D en CableLabs, debatieron sobre las estrategias que las organizaciones deben utilizar para prepararse para la era cuántica. Consulte la sesión aquí.

De algoritmos tradicionales a PQC

Según Housley, el objetivo es implementar algoritmos postcuánticos antes de que exista una computadora cuántica a gran escala capaz de romper los algoritmos de clave pública de uso generalizado en la actualidad. La hipótesis de trabajo es que, a medida que las personas adquieran confianza en los algoritmos PQC y sus implementaciones, los protocolos de seguridad utilizarán una combinación de algoritmos tradicionales y PQC.

Las organizaciones también deben reconocer que la actualización de los esquemas PKI existentes llevará mucho tiempo. Además, los protocolos de seguridad existentes deben actualizarse, lo que también llevará mucho tiempo.

Enfoques para migrar a algoritmos PQC

La migración de los algoritmos de cifrado de clave pública existentes a los algoritmos PQC podría adoptar dos enfoques posibles:

- Dos certificados: Uso de dos certificados, cada uno con una clave pública y una firma. En este caso, el primer certificado utiliza un algoritmo tradicional, mientras que el segundo utiliza algoritmos PQC para la clave pública y la firma.

- Un certificado: Uso de un certificado, que contiene una secuencia de claves públicas tradicionales y PQC, y una secuencia de firmas tradicionales y PQC.

En ambos casos, los protocolos de seguridad deben combinar algoritmos tradicionales y PQC para la confidencialidad y la autenticación basadas en ambos.

- IPSec y TLS utilizarían una Función de Derivación de Claves (KDF) para calcular el secreto compartido a partir de dos entradas [SS = KDF(SST, SSPQC)]

- S/MIME podría hacer lo mismo o utilizar doble encapsulación para la confidencialidad junto con firmas paralelas para la autenticación.

Cada enfoque presenta ciertas ventajas y desventajas.

Ventajas y desventajas de usar un certificado

En el caso de utilizar un solo certificado, los protocolos de seguridad no requerirán nuevos campos, ya que las claves públicas adicionales están en un solo certificado. Sin embargo, los protocolos de seguridad deberán actualizarse para ser compatibles con los algoritmos PQC. Además, no sería necesario modificar la arquitectura del certificado.

Sin embargo, la validación de la ruta del certificado requiere procesos y complejidad adicionales para manejar nuevos casos extremos, como qué sucede si una firma tradicional falla, pero la PQC es válida, o viceversa. ¿Es válido el certificado o no?

Otra desventaja es que el certificado se vuelve enorme y presenta los inconvenientes conocidos de los certificados «jumbo», que en la década de los 90 contenían una clave pública de acuerdo de clave y una clave pública de firma para el mismo usuario. Por eso, hoy en día el Departamento de Defensa de EE. UU. utiliza tres certificados distintos por usuario —uno para el inicio de sesión con tarjeta inteligente, otro para la gestión de claves de cifrado y otro para la firma.

Ventajas y desventajas de usar dos certificados

En el enfoque de dos certificados, los protocolos de seguridad requerirían nuevos campos para los certificados adicionales. A pesar de ello, no sería necesario modificar la arquitectura del certificado y la validación de la ruta del certificado seguiría funcionando como hasta ahora.

Además, evitaremos los inconvenientes conocidos del certificado «jumbo», ya que los dos certificados son ligeramente más grandes que uno solo, solo porque el sujeto, el emisor y otros metadatos se repiten en ambos. Finalmente, cuando el período de transición termine y todos los dispositivos soporten algoritmos PQC, simplemente dejaríamos de usar los certificados con los algoritmos tradicionales.

Basándose en su análisis, Russ Housley recomendó que siguiéramos el enfoque de dos certificados. Su consejo, sin embargo, es comenzar ahora la preparación necesaria en los protocolos de seguridad para combinar los dos certificados y empezar a planificar el día en que solo se utilicen algoritmos PQC.

Una propuesta para la transición de toda una industria

CableLabs ha desarrollado el estándar internacional de telecomunicaciones Data Over Cable Service Interface Specification (DOCSIS) que permite la adición de transferencia de datos de alto ancho de banda a un sistema de televisión por cable (CATV) existente. Es utilizado por muchos operadores de televisión por cable para proporcionar acceso a Internet (véase Internet por cable) a través de su infraestructura híbrida de fibra coaxial (HFC) existente.

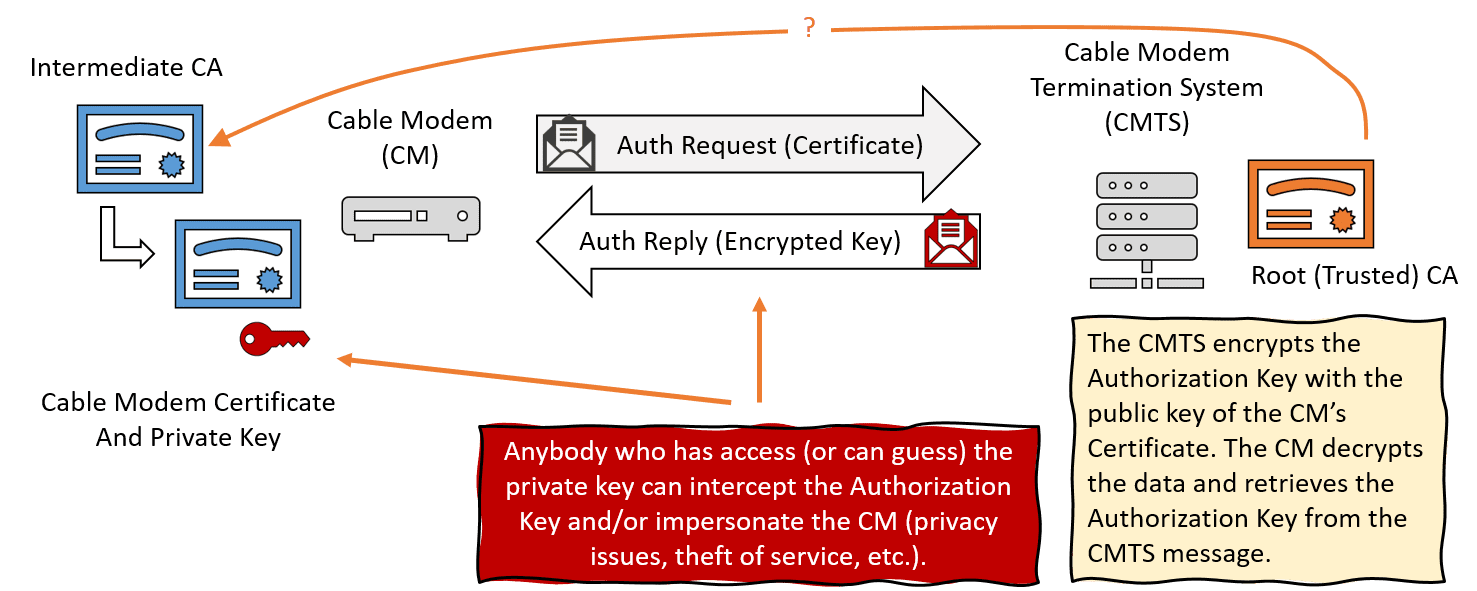

Massimiliano Pala ofreció una breve descripción de cómo DOCSIS aplica la autenticación y la autorización, afirmando que la industria de banda ancha ha aprovechado la PKI para ofrecer una autenticación segura y habilitar Baseline Privacy Interface Plus (BPI+) para cifrar el tráfico de los clientes. El protocolo DOCSIS utiliza dos PKI diferentes que emplean algoritmos RSA para las claves públicas.

A medida que se introduce la noción de redes de Confianza Cero para abordar la necesidad de una autenticación y autorización efectivas de nuevas entidades en las redes, la próxima generación de arquitecturas se basará en la fiabilidad de la PKI. En DOCSIS, la nueva versión de BPI+ permite la autenticación mutua entre dispositivos y redes.

La amenaza cuántica

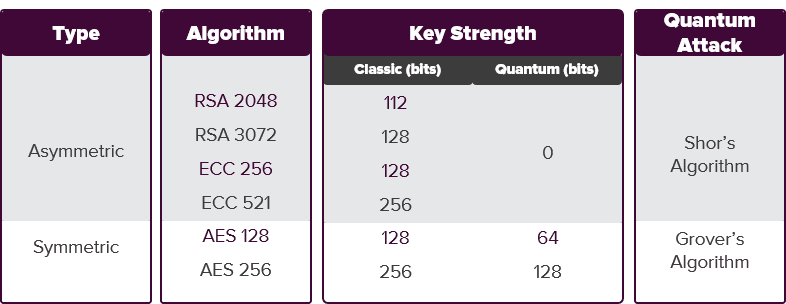

La criptografía clásica se basa en problemas difíciles de revertir. Por ejemplo, la seguridad del algoritmo RSA asume que factorizar números grandes es un problema difícil, mientras que calcular firmas y validarlas es una operación relativamente rápida.

La computación cuántica ha sido el centro de atención en términos de inversiones (Google e IBM) y resultados (complejidad reducida de los ordenadores cuánticos, miles de millones de cúbits, puertas lógicas cuánticas, etc.). Los ordenadores cuánticos pueden ser extremadamente eficientes en la búsqueda de patrones.

Utilizando el algoritmo de Shor, un ordenador cuántico necesita N/2 pasos para factorizar claves en lugar de los 2N/2 requeridos hoy en día —donde N es el número de bits de la clave.

Sin embargo, los ordenadores cuánticos no son tan eficientes cuando no hay una estructura que sondear. La ruptura de algoritmos de cifrado y hash se acelera «solo» cuatro veces mediante el algoritmo de Grover y, por lo tanto, una seguridad de 256 bits aborda este caso de uso.

En DOCSIS, tanto las PKI heredadas como las nuevas utilizan el algoritmo RSA, que pertenece a la clase de problemas que pueden resolverse fácilmente con ordenadores cuánticos. Como resultado, todas las identidades protegidas a través de la PKI no serán seguras y podrán ser suplantadas. Particularmente engorrosa es la factorización de los niveles superiores de la jerarquía PKI, es decir, las CA raíz e intermedias.

En el frente del cifrado, los dispositivos DOCSIS actualmente soportan cifrado de 128 bits. Esto también es un problema porque, bajo el paradigma de la amenaza cuántica, la seguridad de 128 bits se reduce efectivamente a solo 64 bits, lo que puede romperse de manera eficiente.

La infraestructura heredada todavía utiliza algoritmos de hash que no proporcionan seguridad de 256 bits. Esos algoritmos no serán seguros, aunque esto es un problema menor porque la infraestructura DOCSIS 3.0 expirará en menos de 20 años.

Cómo abordar la amenaza cuántica

Para abordar la amenaza cuántica, dijo Massimiliano Pala, debemos considerar cómo podemos aumentar la PKI para soportar algoritmos cuánticamente seguros, sin establecer infraestructuras separadas ni proporcionar soporte de múltiples certificados en los protocolos. Para preservar la seguridad del ecosistema, no solo los certificados, sino todas las estructuras de datos de la PKI deben estar protegidas contra la amenaza cuántica.

Junto con el soporte multi-algoritmo, necesitamos investigar qué algoritmos pueden utilizarse para la validación post-cuántica en dispositivos donde las actualizaciones podrían no ser posibles y/o el soporte para algoritmos cuánticamente seguros no puede implementarse en operaciones de clave privada.

Por lo tanto, existe la necesidad de múltiples patrones de validación:

- Dispositivos postcuánticos capaces de producir y validar autenticaciones seguras frente a la computación cuántica mediante algoritmos postcuánticos. Los algoritmos clásicos se utilizarán para la validación de dispositivos clásicos.

- Los dispositivos clásicos seguirán utilizando el mismo algoritmo (RSA) y deberán emplear claves simétricas precompartidas (PSK) para proteger las firmas y las cadenas de certificados.

- Los dispositivos clásicos con soporte para la validación de algoritmos postcuánticos (PQA) pueden validar directamente la nueva cadena de certificados utilizando tanto el algoritmo clásico como el PQA, pero solo pueden producir autenticación clásica.

Más Información

Aunque es difícil predecir el momento en que un ordenador cuántico representará una amenaza real para los algoritmos criptográficos existentes, las organizaciones deben empezar a planificar con antelación.

Descargue nuestro eBook sobre PKI cripto-ágil para obtener más información sobre cómo puede empezar a planificar hoy mismo.